ENGINEERINGNET.BE - Op Linkedin krijgt ondergetekende geregeld jobs aangeboden via de geïntegreerde jobfunctie. Meestal zijn de geselecteerde vacatures min of meer geschikt voor mijn capaciteiten: copywriter, communicatieverantwoordelijke, technisch vertaler en dergelijke.

Laatst kreeg ik evenwel een vacature voor ‘poetsmedewerker’ voorgesteld in de digitale brievenbus. Dit voorstel sloeg de bal helemaal mis en leidde enkel tot wat gegrinnik aan het thuisfront. Ook het volgende voorstel deed meer dan de wenkbrauwen fronsen, want ‘havenmeester’ is ook niet meteen een functie die mij ligt.

Ik stelde me de vraag hoe LinkedIn in godsnaam plots tot die absurde selecties gekomen was. Wellicht dacht LinkedIn dat de artikels die ik de afgelopen jaren schreef over onderhoud over poetsen gingen, en niet over industrieel onderhoud. De havenmeester zou dan weer te verklaren zijn door het herhaaldelijk reageren op posts van bedrijven die actief zijn in de maritieme sector.

Nood aan transparantie in AI

Voor mij had deze bizarre selectie geen enkel gevolg, ik had dus geen nood aan een uitleg over de achterliggende beslissingsmechanismes. Maar stel nu dat uw bank een beroep zou doen op artificiële intelligentie om te bepalen of u een lening kan krijgen voor uw eerste woning. Een misser die tot een afwijzing leidt, heeft in dit geval een veel ingrijpender gevolg voor de betrokkene.

Of wat als de artificiële intelligentie in militaire drones een wagen vastlegt als potentieel terroristisch gevaar, terwijl het in werkelijkheid een braaf gezin op winkeluitstap betreft? Voor dergelijke gevallen is het niet altijd gezond dat artificiële intelligentie een black box is, de magische plek waar je data instopt en waarin via één van de AI-methodes een resultaat gegenereerd wordt.

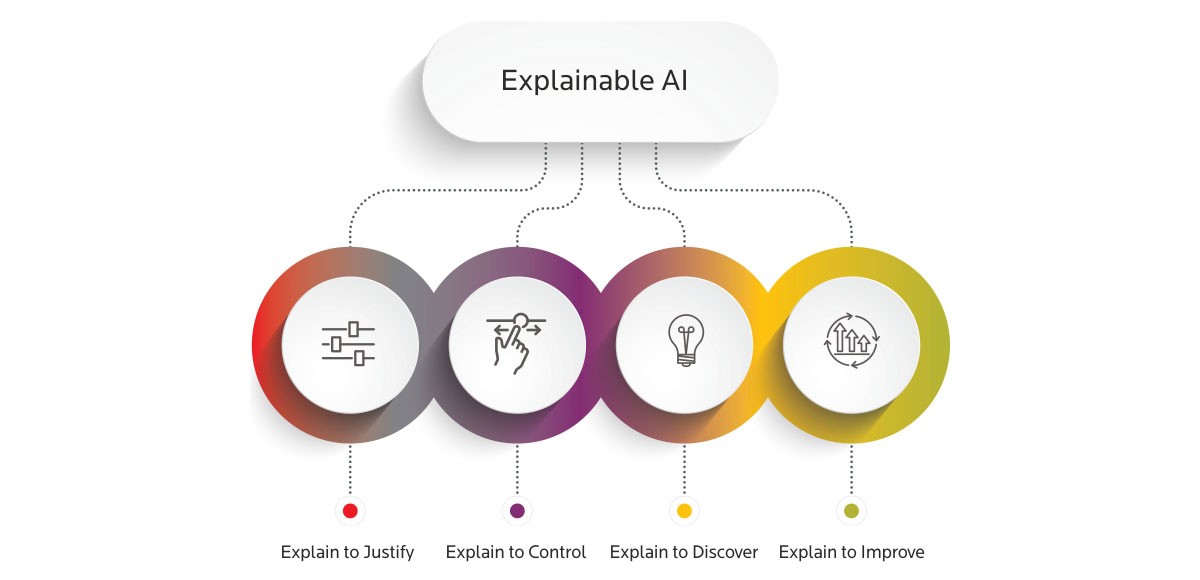

Er is voor veel applicaties nood aan transparantie over het beslissingsproces. En hier kan XAI een antwoord op formuleren. Maar naast dit soort ethische kwesties kan XAI ook voor andere toepassingen ingezet worden, bijvoorbeeld in de industrie.

Vertrouwen krijgen

Professor Bart Bogaerts is lid van het Artificial Intelligence Lab van de VUB. Hij vertelt ons wat meer over het hoe en waarom van XAI: “Het gaat inderdaad een pak breder dan puur ethische kwesties. Ik neem de kwaliteitscontrole van onderdelen via beeldherkenning als voorbeeld. Een menselijke operator zou zich kunnen afvragen: waarom wordt een onderdeel exact uitgestoten?

Het is in sommige gevallen niet altijd duidelijk waarom dat gebeurt, wat tot wantrouwen kan leiden bij de gebruiker. Explainable AI kan dat wantrouwen wat wegnemen door de achterliggende redenen van de beslissing mee te geven. In dit geval zou het bijvoorbeeld kunnen gaan om het aanduiden van een aantal verkleurde pixels op het camerabeeld die wijzen op een anomalie. Als de gebruiker van het systeem inzicht krijgt in het beslissingsproces achter de AI, kan dit bijdragen aan de evaluatie van het systeem en de bevestiging van de betrouwbaarheid.

Ik geef een tweede voorbeeld waarom dit nodig is. Er is een bekende case waarin AI gevraagd werd om op foto’s een wolf te onderscheiden van een husky. De software slaagde erin om een enorm hoog slaagpercentage te behalen. Toen men zocht naar de redenen van deze grote nauwkeurigheid kwam men evenwel tot een ontnuchterende vaststelling. Het waren niet de kenmerken van het dier in kwestie die leidden tot de juiste bepaling, wel de al dan niet aanwezigheid van sneeuw of groen op de achtergrond.

Op quasi alle afbeeldingen met husky’s stonden deze in de sneeuw afgebeeld, terwijl wolven vooral in een bosomgeving gefotografeerd werden. De AI had zijn beslissing dus van de achtergrond laten afhangen, niet op de kenmerken van de dieren. Een husky op een groene achtergrond leidde onvermijdelijk tot een fout resultaat. In dit geval lostte AI dus niet de juiste taak op. XAI heeft dus het voordeel dat beslissingen uitlegbaar zijn en bijgevolg geëvalueerd kunnen worden.

Als er tijdens een productieproces een product uitgeworpen wordt, kan je zo in zekere zin een beeld krijgen van de redenen achter de beslissing. Door deze inzichten kan je veel beter vertrouwen krijgen in het systeem en meer inzicht krijgen. Bij twijfel kan je bij XAI op een zekere manier met het systeem ageren. Het is ook een hendel om het systeem al dan niet te overrulen.”

Tot op welke hoogte uitleggen?

De vraag rijst of het op termijn niet onmogelijk zal worden om AI uit te leggen. Zeker in de industrie, waarbij steeds meer variabelen toegevoegd worden aan systemen, lijkt het of algoritmes steeds uitgebreider worden. Maakt dat ze ook moeilijker uitlegbaar? Bogaerts denk dat het niet zo’n vaart zal lopen: “De vraag is hoe diep je hoeft te gaan om een algoritme uitlegbaar te maken. Stel dat een zelfrijdende wagen 70 km/u rijdt, en je vraagt je af waarom dat zo is op dat moment. Dan volstaat de verwijzing naar het beeld van het verkeersbord dat deze snelheid aangeeft.

Het is niet nodig om ook nog eens de uitgebreide uitleg te krijgen, waarom het algoritme exact denkt dat het bord 70 aangeeft, want dat zie je meteen. In dit geval is het duidelijk tot welk niveau je moet gaan uitleggen, maar één van de uitdagingen is om te bepalen tot op welk niveau we algoritmes moeten uitleggen. Het hangt ook af van de persoon aan wie je een algoritme explainable wil maken.”